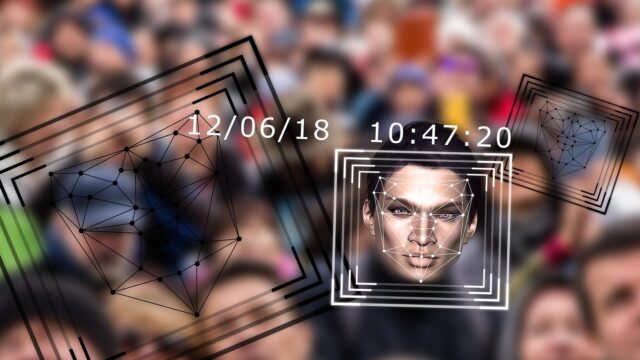

Immaginiamo di passare davanti a una telecamera di sorveglianza all’entrata di uno stadio di calcio: non ti vede, ti ignora, non sei importante per lei. La telecamera è sensibile solo ai volti criminali che le sono noti o alle potenziali minacce alla sicurezza. Non sei sulla lista. Rilassati. Ciononostante, questo ti irrita, perché non consideri etico che una telecamera in uno stadio analizzi il tuo sorriso, i tuoi gesti o possa scoprire di che tipo di tessuto è fatta la tua giacca. Supponiamo che un altro stadio non si prenda la briga di usare la tecnologia di riconoscimento facciale e non riesca così a evitare una minaccia importante. Quanto sarebbe etico, allora, per noi o per gli stadi di calcio non usare la tecnologia di riconoscimento facciale o equivalente? Forse l’etica può arrivare a costringerci ad affrontare il problema da diverse angolazioni, prima fra tutte quella relativa alla privacy. D’altra parte, è vero che non possiamo abbandonare lo spirito critico necessario per analizzare la questione con la profondità che merita.

I problemi di privacy del riconoscimento facciale

Viene da chiedersi: l’uso del riconoscimento facciale è proporzionale ai rischi che si vuole mitigare negli stadi? Probabilmente il 99% dei tifosi va allo stadio solo per divertirsi e godersi il calcio. Quindi vale la pena scannerizzare tutti? Inoltre, se ha senso implementare il riconoscimento facciale in un aeroporto, perché no in uno stadio di calcio? Qual è la differenza?

Forse tutte queste domande sono inutili e la nostra sensazione di disagio si scontra con la realtà. Gli stadi di calcio più moderni sono già il paradigma fisico di piattaforme che, come Facebook, cominciano a conoscerci molto bene, anche quando lasciamo lo stadio. La cosa curiosa è che questa eccessiva attenzione ai nostri dati, se ben usata, può anche essere accettata da noi con piacere, se ci sentiamo curati e coccolati dalla squadra di calcio che amiamo.

Ma la verità è che solo sperimentando queste tecnologie è possibile perfezionarle e comprendere quanto possano proteggerci o quanto possano mettere a rischio i nostri diritti fondamentali. E siccome i test di queste tecnologie stanno già avvenendo, ci chiediamo: dobbiamo abituarci a qualcosa di inevitabile o è il momento di frenare l’offensiva di queste tecnologie? Siamo pronti a sperimentarle con sicurezza e certezza giuridica? Come sviluppare il riconoscimento facciale negli stadi di calcio nel modo più equo possibile e senza violare le normative vigenti? È possibile in territorio europeo?

Sempre di più, l’avanzamento tecnologico ci pone di fronte a un trade off inevitabile tra sicurezza e privacy. Forse non c’è una sola verità, ma un bilanciamento dei diritti e degli interessi in gioco, perché siamo alla ricerca di una soluzione che, più di ogni altra, persegua in modo equilibrato la massima espansione di tutti i diritti e i valori.

Cos’è il riconoscimento facciale?

Secondo la CNIL, l’Autorità francese per la protezione dei dati, il riconoscimento facciale è una tecnica che permette, a partire dalle caratteristiche del viso di:

– autenticare una persona: cioè, verificare che essa sia chi dice di essere (nel contesto del controllo d’accesso)

– identificare una persona: cioè, trovare una persona in un gruppo di individui, in un luogo, un’immagine o un database.

In pratica, il riconoscimento può essere effettuato con immagini fisse (foto) o immagini animate (registrazioni video) e si svolge in due fasi: dall’immagine viene creato un modello o “template” che rappresenta, da un punto di vista informatico, le caratteristiche di questo volto. I dati estratti per comporre questo modello sono dati biometrici ai sensi del GDPR. La fase di riconoscimento viene poi effettuata confrontando questi modelli creati in precedenza con i modelli calcolati dal vivo sui volti presenti nell’immagine candidata.

Nel caso dell’autenticazione, il sistema verifica se l’identità dichiarata è effettivamente quella corretta confrontando il modello del volto presentato con il modello precedentemente registrato corrispondente all’identità dichiarata.

In caso di identificazione, il sistema verifica se il modello facciale presentato corrisponde a uno dei modelli contenuti nel database. I risultati del confronto corrispondono a quello o a quelli con il più alto punteggio di somiglianza tra quelli che superano una certa soglia predeterminata.

Il riconoscimento facciale non deve essere confuso con il rilevamento del volto, che caratterizza la presenza o l’assenza di un volto in un’immagine indipendentemente dalla persona a cui appartiene.

Questa tecnica biometrica di riconoscimento automatico di una persona, basata sulle caratteristiche del suo volto, non deve essere confusa, d’altra parte, con altre tecniche di elaborazione delle immagini (per esempio, con dispositivi “video intelligenti” che possono rilevare eventi o emozioni senza, tuttavia, riconoscere gli individui), con cui può essere talvolta combinata.

Soprattutto, dietro il “riconoscimento facciale” c’è una grande varietà di usi possibili, che vanno dallo sblocco di computer al riconoscimento di una persona ricercata dalle forze di polizia, all’apertura di conti bancari. Non tutti questi usi pongono gli stessi problemi, in particolare in termini di controllo delle persone sui loro dati personali. Ecco perché, come sottolinea la CNIL, è necessario ragionare caso per caso.

I rischi tecnologici legati al riconoscimento facciale

D’altra parte, è importante sottolineare i rischi tecnologici, etici e sociali associati al riconoscimento facciale. Questi rischi sono legati alla natura biometrica del riconoscimento facciale. Qualsiasi violazione o abuso dei dati comporterebbe rischi significativi (blocco dell’accesso a un servizio, furto d’identità, ecc.). Il riconoscimento facciale si basa anche su una probabilità, non sulla certezza assoluta, di una corrispondenza tra il confronto dei volti. Gli errori possono quindi avere conseguenze molto significative per gli individui. Nell’ambiente digitale, dove i volti delle persone sono disponibili in più database e catturati da più telecamere, il riconoscimento facciale può diventare uno strumento particolarmente pervasivo e intrusivo. Perciò, secondo la CNIL questa valutazione dei rischi è necessaria per determinare quali non sono accettabili in una società democratica e quali possono essere presi con garanzie adeguate.

I dubbi tecnici offerti da questa tecnologia hanno portato il Parlamento europeo a pubblicare una risoluzione, il 21 gennaio 2021, sull’intelligenza artificiale e le questioni relative all’interpretazione e applicazione del diritto internazionale nella misura in cui l’UE è interessata relativamente agli impieghi civili e militari e all’autorità dello Stato al di fuori dell’ambito della giustizia penale (2020/2013(INI)) che (56) invita la Commissione a valutare le conseguenze di una moratoria sull’utilizzo dei sistemi di riconoscimento facciale e, in funzione dell’esito di tale valutazione, a prendere in considerazione l’introduzione di una moratoria sull’utilizzo di tali sistemi da parte delle autorità dello Stato nei luoghi pubblici e nei locali destinati all’istruzione e all’assistenza sanitaria, come pure di una moratoria sull’utilizzo dei sistemi di riconoscimento facciale da parte delle autorità di contrasto in spazi semi-pubblici come gli aeroporti, fino a quando le norme tecniche non saranno considerate pienamente conformi ai diritti fondamentali, i risultati ottenuti non saranno privi di distorsioni e di discriminazioni e non vi saranno rigorose garanzie contro gli utilizzi impropri in grado di assicurare la necessità e la proporzionalità dell’utilizzo di tali tecnologie.

Inoltre, Il 28 gennaio 2021, il Comitato della Convenzione 108 ha adottato delle linee guida sul riconoscimento facciale che forniscono una serie di misure di riferimento che i governi, gli sviluppatori di riconoscimento facciale, i produttori, i fornitori di servizi e le entità che utilizzano le tecnologie di riconoscimento facciale dovrebbero seguire e applicare per garantire che non impattino negativamente la dignità umana, i diritti umani e le libertà fondamentali di qualsiasi persona, compreso il diritto alla protezione dei dati personali.

Altri documenti di interesse su questo tema sono: le Linee guida 3/2019 sul trattamento dei dati personali attraverso dispositivi video (EDPB) e il documento emesso dall’Agenzia dell’Unione europea per i diritti fondamentali, intitolato: Tecnologia di riconoscimento facciale: considerazioni sui diritti fondamentali nell’applicazione della legge (novembre 2019)

Cosa dice il GDPR relativamente al riconoscimento facciale

Il considerando 51 precisa che: il trattamento di fotografie non dovrebbe costituire sistematicamente un trattamento di categorie particolari di dati personali, poiché esse rientrano nella definizione di dati biometrici soltanto quando saranno trattate attraverso un dispositivo tecnico specifico che consenta l’identificazione univoca o l’autenticazione di una persona fisica.

L’articolo 4.14 invece, ci offre la definizione di dati biometrici»: i dati personali ottenuti da un trattamento tecnico specifico relativi alle caratteristiche fisiche, fisiologiche o comportamentali di una persona fisica che ne consentono o confermano l’identificazione univoca, quali l’immagine

Secondo il GDPR i dati biometrici sono considerati una categoria particolare di dati personali. L’articolo 9 del GDPR vieta espressamente il trattamento di categorie particolari di dati personali senza una base giuridica speciale o a meno che non si applichi un’eccezione. È possibile trattare i dati biometrici sulla base del consenso della persona interessata, tuttavia, questo può essere difficile da applicare nel contesto del processo di ingresso in uno stadio di calcio¸ a meno che il consenso non sia stato dato in modo inequivocabile, ad esempio, durante il processo di acquisto online di biglietti per le partite di calcio.

L’articolo 9, paragrafo 2, del GDPR stabilisce ulteriori motivi su cui i club calcistici possono basarsi per il trattamento di categorie particolari di dati, compresi i dati biometrici, come nel caso in cui il trattamento sia necessario per motivi di interesse pubblico rilevante, sulla base del diritto dell’Unione o degli Stati membri, che deve essere proporzionato alla finalità perseguita, rispetti l’essenza del diritto alla protezione dei dati e preveda misure appropriate e specifiche per tutelare i diritti fondamentali e gli interessi dell’interessato.

La DPIA da parte dei club di calcio per il riconoscimento facciale

La DPIA ai sensi dell’articolo 35 del GDPR deve essere effettuata se il trattamento previsto dei dati personali può comportare un rischio elevato per i diritti e le libertà di un individuo. Questo è particolarmente importante quando è coinvolto uno dei seguenti elementi:

a) una valutazione sistematica e globale di aspetti personali relativi a persone fisiche, basata su un trattamento automatizzato, compresa la profilazione, e sulla quale si fondano decisioni che hanno effetti giuridici o incidono in modo analogo significativamente su dette persone fisiche;

b) il trattamento, su larga scala, di categorie particolari di dati personali di cui all’articolo 9, paragrafo 1, o di dati relativi a condanne penali e a reati di cui all’articolo 10; o

c) la sorveglianza sistematica su larga scala di una zona accessibile al pubblico, che utilizza soluzioni di riconoscimento facciale per il controllo degli accessi.

La DPIA può anche essere richiesta dopo che un’operazione di trattamento è stata aggiunta alla lista delle tipologie di trattamenti soggetti al requisito di una valutazione d’impatto sulla protezione dei dati o è basata su un requisito stabilito nelle leggi e nei regolamenti nazionali.

Inoltre, la consultazione preventiva è richiesta ai sensi dell’articolo 36 del GDPR se la DPIA indica che il trattamento previsto comporterebbe un rischio elevato per gli interessati e il responsabile del trattamento non è stato in grado di introdurre misure per ridurre il rischio.

È importante che la consultazione preventiva non possa avere luogo fino a quando la DPIA non sia stata effettuata dal responsabile del trattamento dei dati. In seguito, l’autorità competente per la protezione dei dati deve essere consultata, per esempio, se gli interessati potrebbero subire conseguenze significative o irreversibili che potrebbero essere difficili da superare. I titolari dovrebbero richiedere la consultazione preventiva anche nelle situazioni in cui le leggi nazionali li obbligano a consultare e/o ottenere l’autorizzazione preventiva dall’autorità competente per la protezione dei dati. Pertanto, per quanto riguarda le soluzioni di riconoscimento facciale per il controllo degli accessi, soprattutto se eseguito su larga scala, la consultazione preventiva sembra essere necessaria per garantire che tutti i requisiti legali siano soddisfatti.

Il caso: Heysel (Belgio), 1985

Chi scrive era un bambino, ma ricorda bene le immagini sullo schermo televisivo: l’attesa nervosa della ripresa della partita, con giocatori mitici come Boniek, Platini, Tardelli, Grobbelaar, Rush e gli altri. Senza sapere, o capire, la gravità degli eventi che stavano accadendo all’interno dello stadio Heysel di Bruxelles, il 29 maggio 1985.

Circa un’ora prima dell’inizio della finale di Coppa Europa, un gruppo di tifosi del Liverpool attraversò una recinzione che li separava da una zona neutrale contenente principalmente tifosi della Juventus. Per fuggire la minaccia, i tifosi della Juventus restarono intrappolati in una sezione racchiusa da un muro di contenimento in cemento, che alla fine crollò. Morirono trentanove persone e 600 rimasero ferite. La partita fu giocata, nonostante la tragedia, per evitare ulteriori disordini, e la Juventus vinse 1-0.

Oggi, la domanda che dobbiamo porci è se la tecnologia può aiutarci a prevenire o prevedere disastri come quello accaduto nello stadio di Heysel o altre minacce possibili in un mondo sempre più globale. Potremmo analizzare e gestire questo evento oggi come se fosse accaduto 30 anni fa?

Oggi, nei templi del calcio c’è spazio per il riconoscimento facciale? Vediamo alcuni esempi per capire lo stato dell’arte su questo argomento, ovvero alcuni esempi di come le squadre europee stanno implementando il riconoscimento facciale.

Brøndby IF (Danimarca)

Il 13 giugno 2019, la squadra di calcio danese Brøndby IF ha annunciato l’implementazione, dal mese di luglio, della tecnologia di riconoscimento facciale automatizzato (AFR) nello stadio del Brøndby. Il sistema dovrebbe servire a identificare le persone a cui è stato vietato di assistere alle partite di calcio del Brøndby IF per aver violato le regole di condotta del club. Il sistema AFR usa telecamere che scannerizzano le aree di ingresso dello stadio, in modo che le persone sulla lista possano essere “selezionate” tra la folla prima di arrivare all’ingresso.

La Danimarca non ha una legge nazionale specifica che fornisca una base legale per l’uso dell’AFR da parte dei titolari del trattamento dei dati personali insieme a garanzie adeguate per gli interessati. Tuttavia, la sezione 7(4) della Data Protection Act Danese (No. 502 of 23 May 2018) può essere utilizzata per consentire qualsiasi trattamento di dati personali sensibili per legge, compreso l’AFR, supponendo che la soglia di interesse pubblico sostanziale sia soddisfatta. Le osservazioni esplicative della sezione 7(4) affermano che la disposizione deve essere interpretata in modo restrittivo, ma l’effettiva portata della deroga, per il trattamento dei dati, è lasciata alle decisioni di autorizzazione dell’Agenzia danese per la protezione dei dati.

La sezione 7(4) della Data Protection Act Danese

“Il trattamento dei dati di cui all’articolo 9, paragrafo 1, del Regolamento generale sulla protezione dei dati può avere luogo se il trattamento è necessario per motivi di interesse pubblico sostanziale, cfr. articolo 9, paragrafo 2, lettera g), del regolamento generale sulla protezione dei dati. L’autorità di controllo dà la sua autorizzazione a tal fine se il trattamento (…) non è effettuato per conto di un’autorità pubblica[1] “.

A questo punto, l’autorità danese per la protezione dei dati ha deciso che il trattamento con AFR applicato a una lista di divieto dello stadio del Brøndby IF è necessario per motivi di interesse pubblico sostanziale, e che il trattamento è proporzionato all’obiettivo perseguito e sarà usato per trattare i dati personali sensibili di, in media, 14mila persone per ogni incontro di calcio.

Ma quali sono i limiti? Cosa significa il concetto di interesse pubblico sostanziale, dal punto di vista del diritto danese?

Nella legislazione danese sulla protezione dei dati non c’è una definizione fissa, chiara e inequivocabile di ciò che si intende per interesse pubblico sostanziale, quindi è necessario fare un’interpretazione caso per caso, in questo caso legata alla sicurezza in certi grandi eventi sportivi con una grande affluenza.

Come ha dichiarato all’epoca Astrid Mavrogenis, capo unità dell’Autorità danese per la protezione dei dati: “Per dirla tutta, bisogna essere in grado di portare i propri figli a una partita di calcio e sentirsi al sicuro”.

C’è stato qualche dibattito in Danimarca sul fatto che ci sia un sufficiente interesse pubblico sostanziale, il Garante danese ha ritenuto che il calcio sia considerato un evento di massa, in cui l’uso della tecnologia di riconoscimento facciale serve un interesse pubblico sostanziale, assicurando la sicurezza del pubblico presente.

L’esempio danese dimostra che stabilire una base giuridica nel diritto nazionale per un interesse pubblico sostanziale, quando il trattamento non è effettuato per conto di un’autorità pubblica è il fattore chiave, specialmente nei casi di controllo preventivo dell’accesso, dove l’azione basata sul consenso non è potenzialmente disponibile o facilmente applicabile.

Come possiamo vedere, l’articolo 9.2 g) del GDPR[2] stabilisce un motivo di esclusione del consenso esplicito dell’interessato se esiste una base giuridica basata sull’interesse pubblico; ma, come abbiamo visto, la norma danese va oltre e specifica i casi in cui il motivo di interesse pubblico sostanziale non è realizzato per conto di un’autorità pubblica.

D’altra parte, il Brøndby IF ha effettuato una valutazione d’impatto sulla protezione dei dati (“DPIA”) in conformità con l’articolo 35 del GDPR e ha richiesto la consultazione dell’Agenzia della Protezione dei Dati Danese ai sensi dell’articolo 36 del GDPR, prima di attuare il sistema di riconoscimento facciale. Nel sistema proposto in Danimarca, il personale di sicurezza riceve un segnale di allarme quando il sistema rileva una persona il cui accesso è potenzialmente proibito. Il personale di sicurezza può in seguito effettuare dei controlli per confermare se la persona identificata dal sistema si trova effettivamente sulla lista delle persone a cui è vietato l’ingresso.

Quando un interesse pubblico sostanziale è usato come base per il trattamento del riconoscimento facciale, la DPIA e la consultazione preventiva sono di vitale importanza.

Metz (Francia)

Recentemente, uno strumento di analisi video dotato di intelligenza artificiale e apprendimento automatico ha scatenato una grande polemica in Francia. Senza essere nominato espressamente, il FC Metz ha ricevuto un avvertimento dalla CNIL (La Commission nationale de l’informatique et des libertés). Nel suo comunicato stampa, la CNIL ha spiegato come la pratica lanciata dal club francese contravviene alle leggi esistenti, dichiarando che: il sistema di riconoscimento facciale per identificare automaticamente i tifosi nello stadio di calcio non è conforme alla normativa di protezione dei dati.

Come riportato dal club FC Metz su Twitter: “una soluzione di corrispondenza facciale è stata testata solo per far rispettare i divieti di accesso allo stadio. Si applica quindi esclusivamente a coloro che non possono accedere allo stadio”.

Il dibattito è diventato ancora più spinoso quando il ministro dello Sport francese, lo scorso 31 gennaio 2021, ha commentato che “questi esperimenti [di riconoscimento facciale] sono destinati a essere valorizzati nei grandi eventi sportivi che la Francia organizza e in altri eventi sportivi dove la Francia può esportare il suo know-how.”

Il quadro normativo in Francia

Oltre al GDPR e alle leggi francesi sulla protezione dei dati, si applica il Codice sportivo francese.

L’articolo L. 332-1 del Codice dello Sport prevede che gli organizzatori di eventi sportivi possono rifiutare o annullare l’emissione di biglietti per tali eventi o rifiutare l’accesso a coloro che hanno violato le disposizioni delle condizioni generali di vendita o i regolamenti interni relativi alla sicurezza di tali eventi.

Lo stesso articolo autorizza gli organizzatori di eventi sportivi ad attuare “il trattamento automatizzato dei dati personali relativi alle violazioni” per garantire la sicurezza degli eventi sportivi. Questo trattamento deve essere previsto nelle condizioni generali di vendita o nei regolamenti interni.

Questi divieti di accesso agli stadi di calcio, che hanno lo scopo di contribuire alla sicurezza delle manifestazioni sportive impedendo l’accesso a certe persone e che sono decisi dagli organizzatori delle manifestazioni sportive, devono essere distinti dai divieti di accesso agli stadi giudiziari o amministrativi che possono essere imposti solo dalle autorità giudiziarie.

In pratica, la registrazione di una persona a cui è stato vietato l’accesso allo stadio permetterà al sistema di biglietteria dello stadio di rifiutare automaticamente l’emissione di un biglietto a suo nome. Inoltre, le guardie di sicurezza potranno negare l’accesso all’impianto sportivo a una persona registrata in questo trattamento, anche se ha un biglietto di accesso valido.

In particolare, le condizioni di attuazione di questi trattamenti sono specificate dalle disposizioni degli articoli L. 332-1 e R. 332-14 e seguenti del Codice Sportivo, in particolare per quanto riguarda:

– lo scopo di tale trattamento

– le categorie di dati che possono essere trattati

– la durata di questi dati

– le categorie di destinatari di questi dati;

– così come le regole applicabili all’informazione degli individui (tramite pubblicazione o consegna di un documento particolare).

A questo proposito, anche se l’articolo R. 332-15 del codice sportivo francese prevede che la fotografia associata di una persona possa essere trattata per la gestione dei divieti di accesso agli stadi di calcio, esso non permette espressamente l’attuazione di un dispositivo biometrico basato, in particolare, su queste fotografie.

Vediamo cosa dice l’articolo R332-15 citato sopra:

“Solo i seguenti dati e informazioni personali possono essere registrati nel trattamento previsto dall’articolo R. 332-14:

- dati di identificazione: cognome; nome; data e luogo di nascita; indirizzo o luogo di residenza; indirizzo e-mail; numero di telefono; numero di carta di abbonamento e fotografia associata, se applicabile;

- motivi della registrazione che costituiscono una violazione delle disposizioni delle condizioni generali o dei regolamenti interni relativi alla sicurezza delle manifestazioni sportive, in particolare quelli tratti dai seguenti fatti:

a) atto di provocazione all’odio o alla violenza nei campi sportivi o nelle loro immediate vicinanze;

b) atto suscettibile di mettere in pericolo la sicurezza delle persone e dei beni nei campi sportivi o nelle immediate vicinanze dell’evento sportivo;

c) entrare nell’arena sportiva in stato di ebbrezza o sotto l’evidente influenza di sostanze stupefacenti; introdurre e consumare bevande alcoliche e/o sostanze stupefacenti nell’arena sportiva;

d) portare nell’arena sportiva qualsiasi oggetto che possa costituire un’arma o mettere in pericolo la sicurezza di persone e cose;

3. Decisioni prese:

a) Natura della misura: sospensione, cancellazione o impossibilità di sottoscrivere un nuovo abbonamento; rifiuto di vendere un titolo di accesso; cancellazione di tale titolo; rifiuto di accesso a un’arena sportiva;

b) Data della decisione;

c) Durata della misura.

Questi dati sono registrati dalle persone incaricate della sicurezza sotto l’autorità dell’organizzatore di eventi sportivi a scopo di lucro.

Infine, l’articolo R. 332-18 del Codice dello Sport indica esplicitamente che gli interessati non possono opporsi al trattamento dei dati in questi casi.

Si veda: Articolo R332-18: “Il titolare del trattamento informa gli interessati per posta, inviando o consegnando un documento, o con qualsiasi altro mezzo equivalente, indicando l’identità del titolare del trattamento, la finalità del trattamento, l’obbligatorietà delle risposte, le possibili conseguenze della mancata risposta, i destinatari dei dati, il periodo di conservazione e le modalità di esercizio dei diritti degli interessati. Il diritto di opposizione previsto all’articolo 38 della legge del 6 gennaio 1978 non si applica ai trattamenti menzionati all’articolo R. 332-14. I diritti di accesso e di rettifica previsti dagli articoli 39 e 40 della legge del 6 gennaio 1978 sono esercitati direttamente presso il titolare del trattamento”

Pertanto, secondo la CNIL, “in assenza di una disposizione legislativa o regolamentare speciale, l’attuazione di un tale schema da parte di un club sportivo a fini antiterroristici è illegale” perché la raccolta e l’uso di tali dati biometrici è vietata, con eccezioni, dal Regolamento generale sulla protezione dei dati (GDPR) e dalla legge sulla protezione dei dati (Loi Informatique et Libertés). In altre parole, “per quanto riguarda il quadro giuridico, il trattamento previsto non può essere attuato legalmente”.

In questo senso, la CNIL ha avvertito il club che se decidesse di implementare il suo sistema di riconoscimento facciale, “sarà esposto a una o più delle misure correttive previste dai regolamenti sulla protezione dei dati e dalla legge sulla protezione dei dati e delle libertà civili, compresa una sanzione finanziaria”.

Ajax (Olanda)

L’Ajax Football Club si è rivolto alla tecnologia di autenticazione facciale per verificare l’identità degli acquirenti di biglietti e migliorare la sicurezza dei suoi tifosi.

Il club di calcio olandese ha implementato, qualche anno fa, Mobile Verify, un sistema di verifica sviluppato che richiede ai clienti di presentare una foto del loro documento d’identità così come un selfie. Il software usa poi l’intelligenza artificiale per analizzare il documento d’identità presentato e assicurarsi che sia un documento autentico. Utilizza anche algoritmi di corrispondenza biometrica per verificare che il documento d’identità presentato sia usato dal suo legittimo proprietario.

Se leggiamo la politica della privacy dello stadio di calcio Johan Cruijff Arena (Ajax) c’è un’espressa menzione al trattamento fatto dal riconoscimento facciale. Si veda: “Per la vostra e la nostra sicurezza, la Johan Cruijff Arena utilizza una telecamera di sorveglianza. Non conserviamo le immagini più a lungo del periodo richiesto dalla legge. Conserviamo le immagini delle telecamere per adempiere agli obblighi di legge, come le ordinanze dei tribunali in merito all’individuazione e al perseguimento di reati penali. Possiamo trasferire questi dati personali alle autorità competenti per proteggere i nostri diritti e la nostra proprietà. Non è possibile cancellarli. In alcuni casi, le immagini delle telecamere possono essere elaborate per servizi aggiuntivi. Per esempio, l’Arena può darti l’accesso allo stadio tramite il riconoscimento facciale. Questo avviene solo se lo autorizzi esplicitamente. Inoltre, durante gli eventi alla Johan Cruijff Arena vengono fatte foto e video del pubblico per darti un ricordo duraturo della tua visita. In seguito, è possibile visualizzare e salvare queste immagini per uso personale. Queste riprese vengono rimosse 48 ore dopo l’evento. La Johan Cruijff Arena basa questo servizio sul legittimo interesse[3].

In questo caso, la base giuridica utilizzata allo stadio dell’Ajax per autorizzare l’uso del riconoscimento facciale sembra essere il consenso dell’interessato. E per quanto riguarda le foto e i video presi dal pubblico durante il gioco, la base giuridica è il legittimo interesse. Pertanto, in assenza di ulteriori informazioni, deduciamo che queste foto e video non fanno comunque parte di un sistema di riconoscimento facciale.

D’altro canto, il comune di Amsterdam sta sperimentando, la tecnologia di riconoscimento facciale dentro e intorno alla Johan Cruijff Arena, in collaborazione con la polizia nazionale. Questo progetto riguarda il riconoscimento automatico delle persone ricercate dalla polizia.

Questi esperimenti si svolgono intorno alla Johan Cruijff Arena perché si vuole che questo sia uno degli stadi di calcio più sicuri. Lo scopo della polizia, del comune e della Johan-Cruijff Arena è che, sulla base di questa dimostrazione, il dibattito sull’uso e i rischi del riconoscimento facciale possa essere condotto meglio e che il riconoscimento facciale nella sfera pubblica possa, di conseguenza, essere usato in situazioni specifiche e dopo un’attenta considerazione. In questa attenta valutazione, la sussidiarietà è un principio importante. Ciò significa che il riconoscimento facciale non dovrebbe essere usato se l’uso di un mezzo meno invasivo produrrebbe un risultato equivalente. Pertanto, questo studio cerca di esaminare indirettamente anche quelle possibili alternative meno invasive.

Udine e il caso Balotelli

Un sistema di riconoscimento facciale che consente di individuare e bloccare ai tornelli i tifosi a cui è vietato l’ingresso allo stadio è stato sperimentato alla Dacia Arena dall’Udinese in occasione della finale dell’Europeo Under 21.

In Italia il riconoscimento facciale è stato parte di un lungo dibattito con voci che, per combattere il razzismo all’interno del mondo del calcio, hanno sostenuto l’uso di questa tecnologia, e opinioni che, invece, sono state molto più critiche o caute. La questione era sotto i riflettori dei media, soprattutto a causa dei ripetuti canti e insulti razzisti pronunciati nel 2019 e 2020 dai tifosi del Verona, della Lazio e di altre squadre contro Mario Balotelli.

Tra i critici dell’uso di questa tecnologia, con riferimento a un caso applicato alla premier League, c’è Guido Scorza, voce autorevole, componente del Collegio del Garante per la protezione dei dati personali, il quale il 20 agosto 2019 ha scritto un articolo sull’Espresso criticando l’uso di questa tecnologia negli stadi di calcio. “La nostra identità personale vale di più di un pomeriggio senza coda allo stadio” (…) A Manchester si starebbe pensando di usare il viso come biglietto, quando la tecnologia rende ormai disponibili decine di soluzioni più rispettose della privacy ma capaci di garantire lo stesso risultato o quasi”

D’altra parte, Antonello Soro, ex Presidente del Garante per la protezione dei dati personali, in un’intervista scritta ad AlgorithmWatch condotta quando era ancora in carica ha riconosciuto che “il contesto assolutamente peculiare di uno stadio [di calcio] è uno… in cui… l’uso esteso delle tecnologie biometriche… [è]… più evidente”. Di conseguenza, le salvaguardie sono ancora più importanti. E, dal momento che nel 2016 sono diventati evidenti i “pericoli peculiari” della sorveglianza biometrica – “soprattutto quando è strumentale a un processo decisionale algoritmico” – Soro invita a “ulteriori cautele” prima di implementare tali sistemi. In particolare, devono essere resi coerenti con la legge e necessitano di una valutazione dell’impatto sulla privacy.

In contrasto con queste opinioni, il mondo del calcio e anche la politica si sono espressi in modo diverso (almeno prima dell’esplosione della pandemia). Nel febbraio 2020, il Ministro delle Politiche Giovanili e Sportive, Vincenzo Spadafora ha annunciato che il governo italiano stava per sperimentare e impiegare “nuove tecnologie per supportare il lavoro delle forze di polizia” negli stadi di calcio di tutto il paese.

Spadafora non ha specificato di quali “nuove tecnologie” stesse parlando. Ma altri l’hanno fatto. Luigi De Siervo, direttore generale della Lega Serie A, il massimo campionato di calcio italiano, ha detto: “Dobbiamo prendere una per una le persone che stanno rovinando questo sport meraviglioso. Con il riconoscimento facciale è possibile: questo è il lavoro silenzioso che si sta facendo”.

Anche il capo della Federazione Italiana Giuoco Calcio (FIGC), Gabriele Gravina, ha fatto riferimento alla stessa idea e parla anche del possibile ricorso alla tecnologia nella lotta al razzismo negli stadi di Serie A: “Può essere un mezzo molto importante a medio-breve termine. Il nostro progetto a lungo termine prevede un processo di educazione e di formazione nelle scuole, e il ricorso alla tecnologia porterà a un riconoscimento facciale ad alta definizione degli individui che si renderanno colpevoli di questi atti”.

Real Madrid

Ci sono invece altri casi di grandi club di calcio, che, almeno apparentemente, ancora non utilizzano il riconoscimento facciale, come il Real Madrid nello stadio Santiago Bernabeu. Viene menzionata la parola videosorveglianza, senza specificare il tipo di tecnologia utilizzato. Non sappiamo se la protezione del nuovo stadio porterà all’uso di nuove tecnologie che dovranno essere conformi, nel caso in cui vengano effettivamente implementate, alle norme vigenti in materia di protezione dei dati personali in Spagna.

Condividiamo per il momento il frammento relativo alla videosorveglianza inserita nell’informativa sulla privacy del sito web del Real Madrid, relativamente agli acquirenti di biglietti per eventi o partite e partecipanti. Si veda: “Controllo della conformità e della sicurezza, che comprende la consulenza legale e la difesa del Club, il controllo della conformità normativa, la sicurezza nelle nostre strutture, anche attraverso la videosorveglianza, così come la sicurezza nelle partite fuori dalle nostre strutture (compresa la creazione di una lista di tifosi locali). Siamo legittimati a farlo dal legittimo interesse che il Club ha nel garantire il corretto sviluppo e la sicurezza nelle nostre attività, oltre ad essere necessario per garantire l’interesse pubblico e il rispetto delle normative a cui siamo soggetti (tra le altre, la legge 19/2007 contro la violenza, il razzismo, la xenofobia e l’intolleranza nello sport e la normativa che la sviluppa)”.

Conclusioni

La declinazione concreta in ogni nazione europea del GDPR e la diversa cultura e sensibilità nell’interpretare il trade off tra sicurezza e privacy può dar luogo, pur condividendo gli stessi principi normativi, a diverse applicazioni su questo tema che è davvero spinoso perché protegge due diritti fondamentali essenziali in una società democratica, che devono essere bilanciati adeguatamente e implementati rispettando tutte le garanzie costituzionali e normative.

La tecnologia di riconoscimento facciale offre molte possibilità per il controllo degli accessi allo stadio, ma tale tecnologia è soggetta a requisiti particolarmente rigorosi sotto il GDPR, in quanto comporta il trattamento di dati biometrici e, come tale, rientra nell’ambito dell’articolo 9 per le categorie particolari di dati. L’istituzione di una base giuridica valida può variare da paese a paese all’interno dell’UE, a causa delle differenze nell’applicazione delle leggi e dei regolamenti nazionali. L’uso della DPIA e la consultazione preventiva attraverso il Garante per la protezione dei dati personali nazionale è della massima importanza in questi casi. Ma non solo, sarà anche essenziale che la squadra di calcio si assicuri che il trattamento dei dati personali sia assolutamente necessario per le attività che sta svolgendo, e che non ci siano altri metodi disponibili per raggiungere tale scopo, che non comportino il trattamento di dati personali, sensibili o particolari. Inoltre, sarà di fondamentale importanza documentare le decisioni relative all’uso del riconoscimento facciale. Se il club decide che il suo trattamento è legittimo e legale, deve giustificare la sua decisione e le altre opzioni che ha esplorato per dimostrare che ha analizzato altre strade e che ritiene che il suo trattamento sia comunque legittimo.

E infine, utilizzare misure tecniche e di sicurezza adeguate. È fondamentale che, se la società calcistica decide di trattare dati personali, questi dati siano tenuti organizzati e sicuri e cancellati non appena non sono più necessari.

D’altra parte, è interessante sottolineare che ci sono contrasti e opinioni divergenti – per esempio in Italia e in Francia – sull’uso della tecnologia negli stadi di calcio tra, da una parte i membri del governo, squadre di calcio e/o dirigenti nel mondo del calcio e, dall’altra, le autorità di protezione dei dati.

Il dibattito è ugualmente aperto a livello tecnico? È necessario usare il riconoscimento facciale o ci sono altre tecnologie o procedure meno invasive che possono produrre risultati simili? L’ultima risoluzione del Parlamento europeo (21 gennaio 2021) invita la Commissione a valutare le conseguenze di una moratoria sull’utilizzo dei sistemi di riconoscimento facciale da parte delle autorità dello Stato nei luoghi pubblici e in spazi semi-pubblici come gli aeroporti, fino a quando le norme tecniche non saranno considerate pienamente conformi ai diritti fondamentali.

Infine, non possiamo dimenticare che uno stadio di calcio, anche se di proprietà e gestione privata, è un luogo pubblico, esposto a rischi collettivi. Occorre capire qual è il prezzo che vogliamo pagare per entrare nello stadio. La nostra privacy o la nostra sicurezza?

Note

- (4) The processing of data covered by Article 9(1) of the General Data Protection Regulation may take place if the processing is necessary for reasons of substantial public interest, see point g) of Article 9(2) of General Data Protection Regulation. The supervisory authority shall give its authorisation for this purpose if the processing pursuant to the first sentence of this subsection is not carried out on behalf of a public authority. Authorisation given by virtue of the second sentence of this subsection may lay down more detailed terms for the processing. ↑

- 9.2 g) GDPR : il trattamento è necessario per motivi di interesse pubblico rilevante sulla base del diritto dell’Unione o degli Stati membri, che deve essere proporzionato alla finalità perseguita, rispettare l’essenza del diritto alla protezione dei dati e prevedere misure appropriate e specifiche per tutelare i diritti fondamentali e gli interessi dell’interessato; ↑

- For both your and our own safety, the Johan Cruijff Arena uses camera surveillance. We do not keep the images longer than the legally required period. We keep these camera images to comply with legal obligations such as court orders regarding the detection and prosecution of criminal offenses. We may transfer this personal data to the competent authorities to protect our rights and property. It is not possible to unsubscribe from this. In some cases, camera images may be processed for additional services. For example, the Arena can give you access to the stadium by facial recognition. This only happens when you explicitly authorize it. In addition, photos and videos are made of the public during events in the Johan Cruijff Arena to give you a lasting memory of your visit. Later, you can view and save these images for personal use. This footage is removed 48 hours after the event. Hereby the Johan Cruijff Arena bases this service on legitimate interest. ↑